Dopo il carbone e l’acciaio, sui quali è stata fondata la Rivoluzione Industriale, le risorse più importanti nel ventunesimo secolo sono diventate l’energia e l’informazione, entrambe immateriali. Naturalmente, Einstein ci ha insegnato che anche la materia non è altro che uno stato condensato dell’energia, ma è innegabile che, anche in termini economici, l’attenzione dell’umanità sia sempre più rivolta verso risorse sempre meno tangibli. Come vedremo, energia e informazione interagiscono fra loro a livelli più fondamentali di quanto possa sembrare.

II° PRINCIPIO DELLA TERMODINAMICA: LA FRECCIA DEL TEMPO

La Termodinamica ci dice che in un sistema isolato l’energia non si crea né si distrugge, ma effettuando del lavoro (cioè modificando lo stato degli elementi interni del sistema) si ridistribuisce in modo da ridurre le disomogeneità.

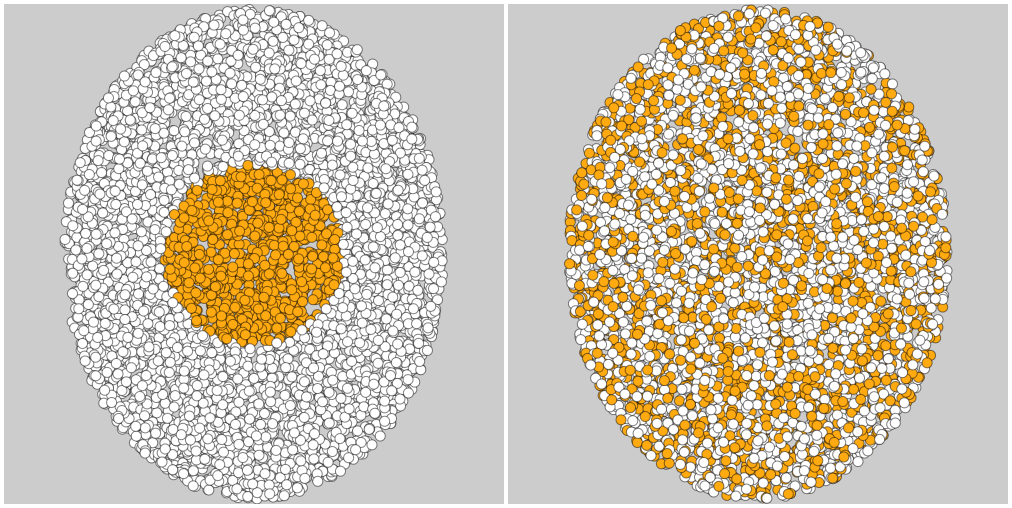

A livello microscopico, il numero di possibili stati disordinati delle particelle è assai più numeroso del numero di possibili stati ordinati.

A livello macroscopico, questo rende gli stati omogenei enormemente più probabili di quelli disomogenei e fa sì che ogni sistema tenda spontaneamente verso gli stati più omogenei: un cubetto di ghiaccio si scioglie nel bicchiere, le montagne vengono erose, le stelle si consumano.

Perfino gli esseri viventi, che consumano grandi quantità di energia per crescere e dare strutture meravigliosamente ordinate ai propri corpi, appena l’apporto di energia cessa muoiono, si decompongono e tornano materia amorfa.

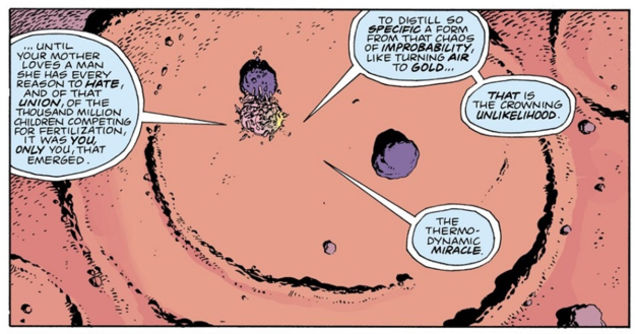

Questa avanzata inesorabile verso l’equilibrio energetico è l’unico fenomeno fisico che fa distinzione fra “passato” e “futuro”: tutti gli altri fenomeni possono essere “riavvolti” come un film. La possibilità di ricomporre un uovo partendo da una frittata, però, si scontra contro una barriera di improbabilità talmente elevata da richiedere quantità enormi di energia oppure, per avvenire spontaneamente, un vero e proprio “miracolo termodinamico”. Si può dire che la cosiddetta “freccia del tempo”, cioè la nostra percezione che il tempo “scorra” in una sola direzione e le informazioni si propaghino dal passato verso il futuro e mai viceversa, derivi unicamente da questo Principio, il secondo della Termodinamica.

COSA DISTINGUE LA FRITTATA DALL’UOVO FRESCO? IL CONCETTO DI ENTROPIA.

Eppure, cosa distingue la frittata dall’uovo fresco? Gli atomi sono gli stessi e il livello energetico complessivo non è poi molto diverso. Anzi, se la cottura avviene all’interno di un ambiente totalmente isolato, il livello energetico rimane esattamente lo stesso, in base al Primo Principio della Termodinamica.

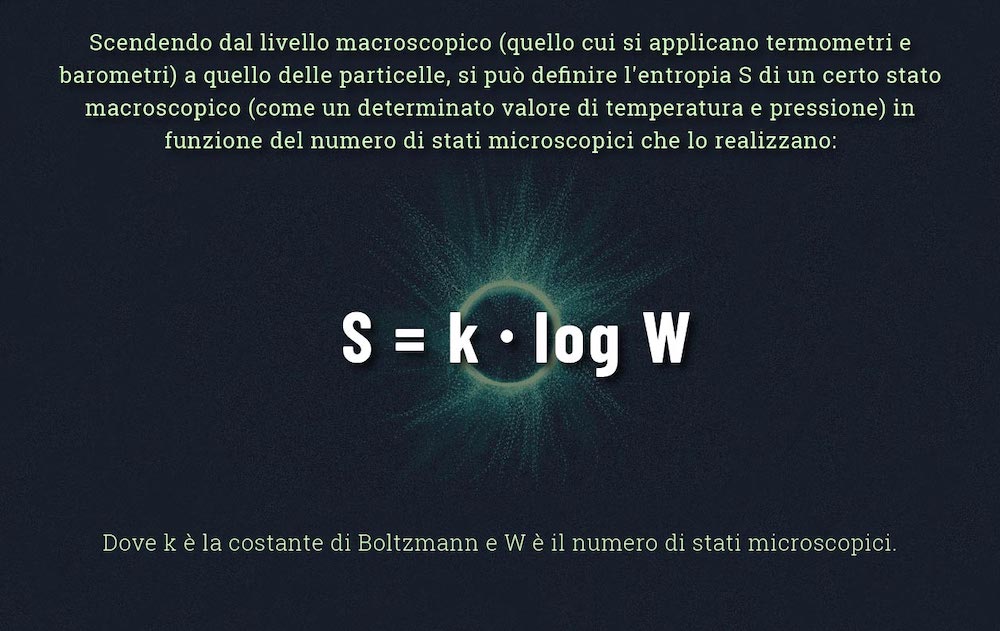

Ciò che cambia è la grandezza chiamata “entropia”. Il fisico Rudolf Clausius nel 1864, in piena Rivoluzione Industriale, la definì come il rapporto fra l’aumento di calore in un cambiamento di stato e la temperatura assoluta alla quale esso avviene.

Nell’uovo: lo stato macroscopico originale è quello nel quale tutte le molecole di tuorlo si trovano entro un certo raggio, e tutte le molecole di albume fuori da quel raggio.

Nell’uovo strapazzato: non c’è questa distinzione, ammettendo così un numero molto maggiore di stati microscopici per essere realizzato.

Risultato? Dopo che abbiamo speso energia per sbatterlo con la forchetta, l’uovo è passato a un livello di entropia superiore. E in tutto quel mescolamento abbiamo perso traccia della posizione esatta delle singole molecole: abbiamo perso informazione.

CLAUDE SHANNON E L’ENTROPIA DELL’INFORMAZIONE

Non si può misurare quantitativamente l’informazione senza l’aiuto di Claude Shannon, padre della Scienza dell’Informazione, che nel 1948 postulò il suo primo Teorema.

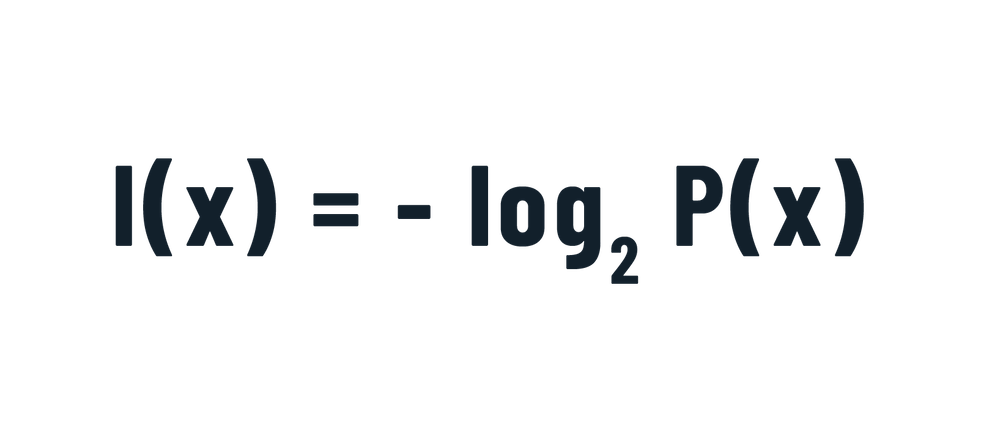

Parlando di telecomunicazioni, in base ad esso, l’informazione intrinseca presente in un segnale x emesso da una sorgente X equivale a:

dove P(x) è la probabilità di emissione di quel particolare segnale fra tutti i possibili.

In parole povere, se una lampadina si accende e spegne del tutto a caso, la probabilità di osservarla accesa in un dato momento è 1/2 e l’informazione fornita dall’osservazione è pari a 1 bit.

E se fosse un uovo? Come abbiamo visto, a causa del minor numero di stati microscopici che lo realizzano, l’osservazione “uovo intero” è meno probabile dell’osservazione “uovo strapazzato”.

L’informazione associata a quello stato macroscopico è quindi maggiore di quella associata allo stato “strapazzato”, che termodinamicamente si trova ad entropia più elevata.

Riassumendo, ogni volta che si usa dell’energia per compiere del lavoro si incrementa l’entropia e si riduce la quantità di informazione estraibile dal sistema.

E indietro non si torna: la “freccia del tempo” impostaci dal Secondo Principio della Termodinamica fa sì che in un sistema chiuso (come l’Universo) l’informazione complessiva possa solo diminuire.

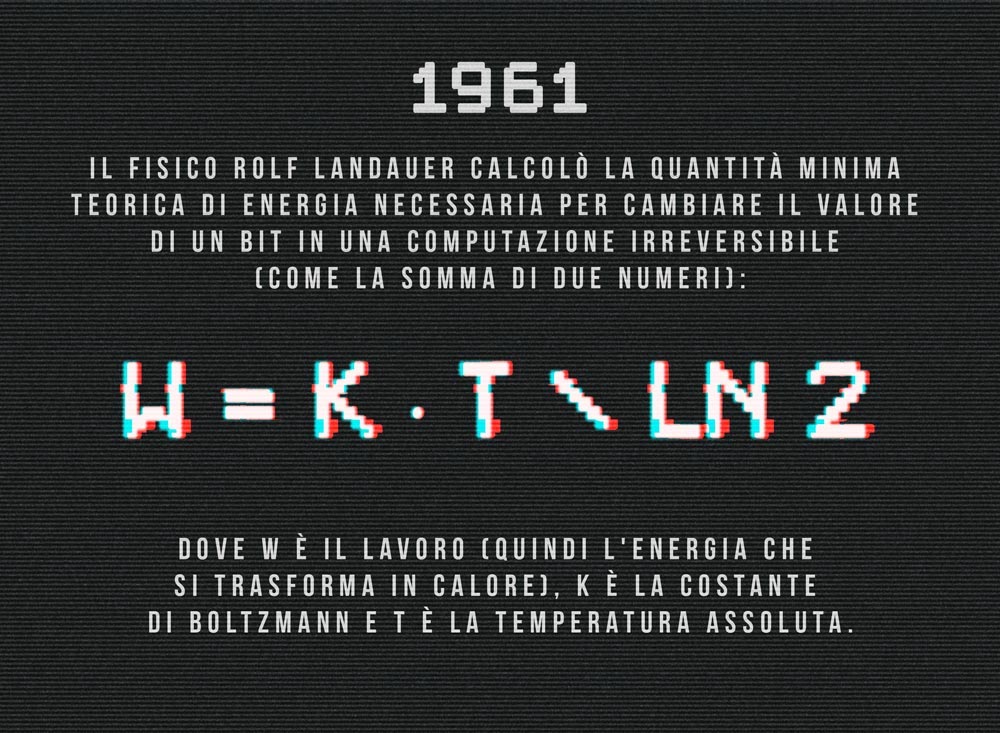

Viceversa, per alterare lo stato dell’informazione in un sistema chiuso, ossia per compiere qualunque tipo di elaborazione, è inevitabile usare dell’energia, facendo così crescere l’entropia.

Ad esempio, per cambiare un bit a 25°C non è possibile spendere meno di 0,0178 elettronvolt. Una quantità molto piccola, ma un limite teorico dal quale gli elaboratori attuali sono ancora molto lontani.

DUE PICCOLI ESPERIMENTI

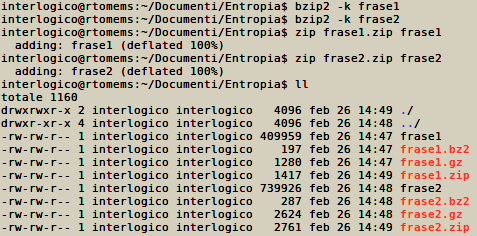

Esiste un modo molto semplice per ottenere una buona approssimazione del numero di bit di informazione intrinseca presenti nella descrizione di uno stato. Gli algoritmi moderni di compressione dei dati sono molto efficienti e si avvicinano abbastanza ai limiti teorici di Shannon.

Possiamo quindi prendere la descrizione di una scena prima e dopo una variazione di entropia e verificare, pur se in modo molto approssimativo, se il numero di bit necessari a descriverla cambia.

Se ci limitiamo al testo, è palese che la frase:

“Un bicchiere con 33 ml di acqua a 10°C.”

è più breve della frase:

“Un bicchiere con 30 ml di acqua a 12°C e un cubetto di ghiaccio a -4°C.”

Tuttavia, la lunghezza di una stringa non è necessariamente proporzionale al suo contenuto di informazione intrinseco: si può creare un file di molti megabyte contenente la parola “ciao” ripetuta migliaia di volte, e il suo contenuto sarà molto ridotto.

Un algoritmo di compressione rivela questo aspetto, producendo un file molto piccolo. Analogamente, scrivendo le due frasi precedenti ripetute 10000 volte rispettivamente nei file “frase1” e “frase2” e poi comprimendoli con i comuni algoritmi ZIP, GZIP e BZIP2 si ottengono queste dimensioni dei file compressi:

Al netto di un certo overhead, è lampante che anche dopo la compressione la frase più lunga, dovendo descrivere un sistema più articolato (come l’uovo col tuorlo ancora intero) occupa un numero maggiore di bit.

Cambiando radicalmente metodo di descrizione, e in modo ancor meno scientifico, la stessa prova si può fare con le immagini. La foto del sistema a bassa entropia (con i cubetti di ghiaccio), ripresa in condizioni quanto più invariate possibili e compressa in JPEG con gli stessi parametri, occupa più bit di quella del sistema ad alta entropia (dopo lo scioglimento del ghiaccio):

CONCLUSIONE

L’informazione, in conclusione, non è solo ciò che ci permette di gestire con efficienza sempre maggiore produzione, distribuzione e consumo delle risorse energetiche. È anche una caratteristica della realtà intrinsecamente connessa con la natura stessa dell’energia.

VUOI APPROFONDIRE L’ARGOMENTO?

La blockchain e l’energia, cosa accadrà?